Introduction

À mesure que les organisations migrent vers le cloud et adoptent des architectures distribuées, la quantité de données de télémétrie explose. Logs applicatifs, métriques d’infrastructure, traces distribuées, événements de sécurité : tout converge vers une même plateforme d’analyse. Sur Azure, cette plateforme repose en grande partie sur Azure Log Analytics, un service puissant qui permet de collecter, stocker et interroger des volumes massifs de données.

Dans la majorité des cas, le modèle standard de Log Analytics répond parfaitement aux besoins. Mais lorsque les volumes deviennent très importants, que les exigences de performance se durcissent ou que des contraintes d’isolation apparaissent, une autre approche s’impose. C’est dans ce contexte que les clusters dédiés Log Analytics prennent tout leur sens.

Cet article propose de comprendre en profondeur ce qu’ils sont, pourquoi ils existent, et dans quels cas ils représentent un choix pertinent.

Mise en contexte : l’explosion des données d’observabilité

L’observabilité moderne ne se limite plus à surveiller quelques machines virtuelles. Elle englobe aujourd’hui des plateformes complètes : microservices, Kubernetes, services managés, pipelines CI/CD, solutions de sécurité avancées. Chaque composant génère des logs, souvent en grande quantité.

Avec des outils comme Microsoft Sentinel, qui s’appuie directement sur Log Analytics, les volumes peuvent rapidement atteindre plusieurs centaines de gigaoctets par jour. Dans certains environnements, notamment en cybersécurité ou dans les grandes plateformes SaaS, on parle même de téraoctets quotidiens.

Cette croissance pose trois défis majeurs. Le premier concerne la performance des requêtes analytiques, qui doivent rester rapides même sur de très grands volumes. Le second est lié à la prévisibilité des coûts. Le troisième touche à la gouvernance et à l’isolation des données, notamment dans des contextes réglementés.

Le modèle initial : une plateforme mutualisée efficace, mais avec ses limites

Historiquement, Log Analytics repose sur une architecture mutualisée. Concrètement, cela signifie que les données de nombreux clients sont traitées sur une infrastructure partagée, même si une isolation logique stricte est bien sûr assurée.

Ce modèle présente des avantages indéniables. Il simplifie énormément l’adoption, car il n’y a aucune infrastructure à gérer. Il permet également de bénéficier d’une élasticité quasi infinie, sans avoir à dimensionner ou planifier des capacités.

Cependant, à grande échelle, certaines limites apparaissent. Les performances des requêtes peuvent varier légèrement en fonction de la charge globale du service. Cette variabilité reste généralement faible, mais elle peut devenir perceptible dans des environnements très exigeants.

La gestion de multiples workspaces indépendants peut aussi devenir complexe. Dans une grande organisation, il n’est pas rare d’avoir des dizaines, voire des centaines de workspaces répartis par environnement, par équipe ou par domaine fonctionnel. Sans mécanisme de mutualisation, l’optimisation des coûts devient plus difficile.

Enfin, certaines exigences avancées en matière d’isolation ou de conformité peuvent nécessiter un niveau de contrôle plus fin que celui offert par une plateforme partagée.

L’émergence des clusters dédiés : une réponse aux besoins à grande échelle

Pour répondre à ces enjeux, Microsoft a introduit les clusters dédiés Log Analytics. L’idée est simple : fournir à une organisation un ensemble de ressources de calcul et de stockage qui lui sont entièrement réservées, tout en conservant l’expérience utilisateur de Log Analytics.

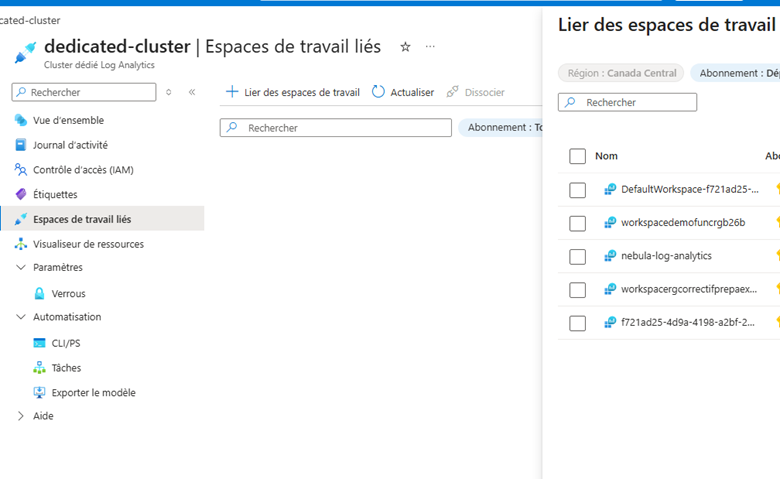

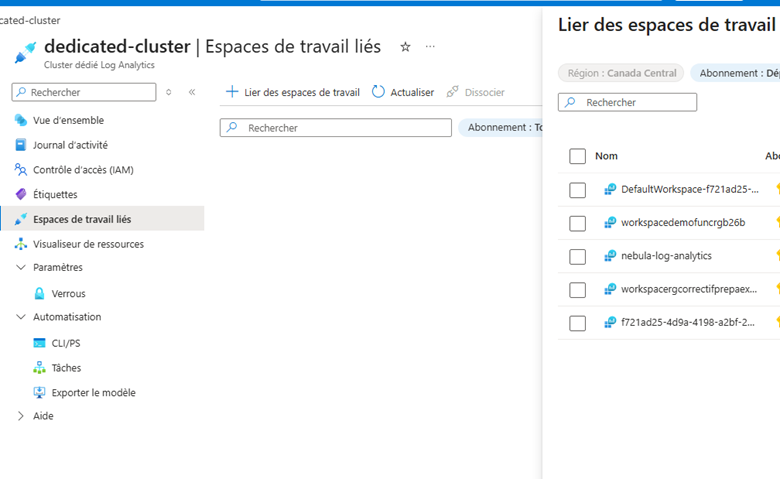

Dans ce modèle, plusieurs workspaces peuvent être rattachés à un même cluster dédié. Ce cluster devient alors le point central de traitement et de stockage des données. Contrairement au modèle mutualisé, les ressources ne sont plus partagées avec d’autres clients, ce qui permet d’obtenir une meilleure prévisibilité des performances.

Cette approche ne remplace pas le modèle existant, mais vient le compléter. Elle s’adresse clairement à des scénarios où la volumétrie, les exigences de performance ou les contraintes organisationnelles justifient un niveau de contrôle supérieur.

Ce que les clusters dédiés changent concrètement

L’un des premiers bénéfices est la stabilité des performances. Dans un cluster dédié, les ressources étant réservées, les requêtes analytiques bénéficient d’un environnement plus prévisible. Cela est particulièrement important pour les équipes de sécurité qui exécutent des requêtes complexes en continu, ou pour les équipes d’exploitation qui s’appuient sur des dashboards critiques.

Un autre avantage majeur réside dans la mutualisation de la capacité d’ingestion. Plutôt que de gérer chaque workspace individuellement, l’organisation peut regrouper ses besoins au niveau du cluster. Cette approche permet une meilleure optimisation des coûts lorsque les volumes sont élevés et relativement constants.

Les clusters dédiés facilitent également la gouvernance. Ils offrent un point de contrôle centralisé pour plusieurs workspaces, ce qui simplifie la gestion dans les environnements complexes. Cette centralisation s’inscrit bien dans les approches structurées comme les landing zones Azure, où les responsabilités sont clairement réparties.

Enfin, ils permettent de répondre à des exigences d’isolation avancées, que ce soit pour des raisons de sécurité, de conformité ou de segmentation organisationnelle.

Les limitations : un modèle puissant, mais exigeant

Malgré leurs avantages, les clusters dédiés ne sont pas une solution universelle. Leur principal frein est l’engagement minimal requis. Pour justifier leur mise en place, il faut généralement un volume d’ingestion d’au moins 100 Go par jour. En dessous de ce seuil, le modèle standard reste souvent plus économique et plus simple.

Ce modèle introduit également une complexité accrue. Là où un workspace standard peut être déployé en quelques minutes, un cluster dédié nécessite une réflexion plus approfondie. Il faut planifier le rattachement des workspaces, anticiper les volumes futurs et surveiller l’utilisation du cluster.

La gestion des coûts devient aussi plus structurée. L’engagement implique une certaine prévisibilité, mais il nécessite également une bonne compréhension des patterns d’ingestion. Une mauvaise estimation peut conduire à un surcoût ou à une sous-utilisation des ressources.

Enfin, il est important de noter que tous les scénarios ne bénéficient pas significativement de ce modèle. Pour des environnements à faible ou moyenne volumétrie, les gains en performance et en gouvernance ne compensent pas toujours la complexité supplémentaire.

Quand faut-il envisager un cluster dédié ?

La décision d’adopter un cluster dédié ne doit pas être prise uniquement sur des critères techniques. Elle doit s’appuyer sur une analyse globale des besoins.

Les clusters dédiés deviennent pertinents lorsque les volumes de données sont élevés et relativement stables, lorsque les performances des requêtes sont critiques, ou lorsque l’organisation doit gérer un grand nombre de workspaces avec une gouvernance centralisée.

Ils sont également particulièrement adaptés aux environnements de sécurité avancée, notamment lorsque Microsoft Sentinel est utilisé à grande échelle. Dans ce contexte, la stabilité des performances et la capacité à traiter de grands volumes de données sont essentielles.

En revanche, pour des environnements plus modestes ou très dynamiques, le modèle mutualisé reste souvent le meilleur choix. Il offre une grande flexibilité, sans engagement ni complexité supplémentaire.

Une brique dans une stratégie d’observabilité mature

Les clusters dédiés ne doivent pas être vus comme une simple option technique, mais comme une composante d’une stratégie d’observabilité à grande échelle. Ils prennent tout leur sens lorsqu’ils sont intégrés dans une architecture globale, avec une gouvernance claire, des standards de collecte bien définis et une gestion rigoureuse des coûts.

Ils permettent de structurer la plateforme autour d’un modèle plus centralisé, tout en conservant la flexibilité des workspaces. Cette combinaison est particulièrement intéressante dans les grandes organisations, où les enjeux de coordination et de standardisation sont importants.

Conclusion

Les clusters dédiés Azure Log Analytics représentent une évolution naturelle de la plateforme pour répondre aux besoins des environnements les plus exigeants. Ils apportent des gains significatifs en termes de performance, de prévisibilité et de gouvernance, mais au prix d’un engagement et d’une complexité plus élevés.

Ils ne sont pas nécessaires dans tous les cas, et le modèle standard reste parfaitement adapté à une grande majorité de scénarios. Mais pour les organisations qui opèrent à grande échelle, ou qui ont des exigences avancées, ils constituent un levier puissant pour structurer et optimiser leur plateforme d’observabilité.

En définitive, le choix entre un workspace standard et un cluster dédié n’est pas une question de “meilleur” ou de “moins bon”, mais de pertinence par rapport au contexte. C’est cette capacité à faire le bon choix au bon moment qui distingue une architecture simplement fonctionnelle d’une architecture réellement maîtrisée.